📝 RESUMEN

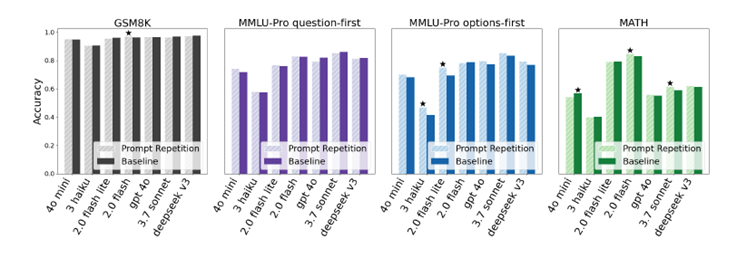

En la era de la inteligencia artificial, se ha creado el mito de que existe una “ingeniería de prompts” perfecta; fórmulas mágicas y complejas para obtener la mejor respuesta de modelos como GPT, Gemini o Claude. Sin embargo, un nuevo estudio de Google Research demuestra que una estrategia absurdamente simple es mucho más efectiva: repetir la pregunta dos veces. Los investigadores descubrieron que ingresar <PREGUNTA> <PREGUNTA> en modelos que no están en modo de “razonamiento profundo” mejora drásticamente su precisión. Esto se debe a la forma en que los modelos procesan la información de manera unidireccional. Este hallazgo es invaluable para investigadores y estudiantes, ya que optimiza los resultados sin aumentar el tiempo de respuesta.

1. La Ilusión de la “Ingeniería” de Prompts 🪄📉

¡GRACIAS POR LEER NUESTRAS NOTICIAS! ¿Nos invitas un cáfe? ☕

Todos hemos pasado minutos (o horas) reescribiendo una instrucción para que la IA entienda exactamente qué queremos que analice o resuma. Nos han enseñado a poner primero el contexto, luego la pregunta, o viceversa, buscando el “orden perfecto”. Sin embargo, investigadores de inteligencia artificial han descubierto que, en lugar de buscar la formulación impecable, simplemente “repetirle” las cosas al modelo elimina el problema del orden de los factores.

2. El Mecanismo: Leyendo en dirección 5′ a 3′ 🧬⏩

Para entender por qué funciona la repetición, hay que comprender cómo “lee” la IA. Los grandes modelos de lenguaje (LLMs) se entrenan de forma causal. Esto significa que predicen la siguiente palabra únicamente a partir de las palabras anteriores.

Piensa en esto como una polimerasa o un ribosoma que lee una secuencia biológica estrictamente en la dirección 5′ a 3′. No pueden “ver” lo que hay más adelante en la secuencia hasta que llegan ahí. Si tú le escribes a la IA: <CONTEXTO LARGO> + <PREGUNTA>, cuando la IA estaba procesando las primeras palabras del contexto, no tenía ni idea de cuál iba a ser la pregunta final, por lo que no le prestó la atención “correcta” a los datos críticos.

3. La Magia de la Repetición (Atención Total) 🔄🧠

Aquí es donde entra la solución del estudio: repetir el prompt completo. Si tú ingresas <CONTEXTO + PREGUNTA> + <CONTEXTO + PREGUNTA>, ocurre algo fascinante.

Durante la segunda pasada, las palabras iniciales del contexto ya pueden interactuar matemáticamente (gracias a un mecanismo llamado “atención”) con la pregunta formulada en la primera pasada. Es como si le dieras al ribosoma la capacidad de ver la secuencia completa del ARNm antes de empezar a traducir. Ahora, cada palabra (token) del segundo bloque de texto tiene acceso a la intención total de tu consulta, lo que permite que el modelo procese la información con un enfoque mucho más agudo y preciso.

4. Perspectivas: Lo Positivo y las Limitaciones del Método ⚖️🔭

Como con todo avance tecnológico, esta estrategia tiene implicaciones prácticas brutales, pero también ciertas barreras que debemos considerar al usar nuestras herramientas bioinformáticas o de escritura diaria.

Lo Positivo e Impresionante:

- Costo de Latencia Cero: A diferencia de pedirle a la IA que “piense paso a paso” (lo cual hace que tarde mucho en responder y genere mucho texto intermedio), repetir el prompt de entrada no aumenta el tiempo que tarda el modelo en darte la respuesta final, ni aumenta la longitud de la misma.

- Universalidad: Funciona en la mayoría de los modelos populares actuales y corrige la asimetría del orden. Ya no importa si pones la pregunta al principio o al final de tu texto; al repetirlo, el modelo captura la estructura completa.

Las Limitaciones que Debemos Tener en Cuenta:

- Consumo de Ventana de Contexto: Al duplicar tu texto de entrada, estás gastando el doble de “tokens” (las unidades de memoria de la IA). Si estás analizando un artículo científico gigante o un set de datos masivo, repetir todo podría exceder el límite de memoria que el modelo te permite ingresar de una sola vez.

- Solo para Modelos No Razonadores: El estudio aclara que este truco es específico para cuando los modelos operan de forma estándar (sin el modo de razonamiento lento o “chain-of-thought” activado). Si el modelo ya está usando bucles de razonamiento interno complejos, la repetición no añade una ventaja significativa.

📚 REFERENCIA BIBLIOGRÁFICA

Leviathan, Y., Kalman, M., & Matias, Y. (2025). Prompt Repetition Improves Non-Reasoning LLMs. arXiv preprint arXiv:2512.14982. https://arxiv.org/abs/2512.14982